You all know that knowledge is power. You have to perform some data collection tasks to gain access to the best pieces of information. One of the best methods is web scraping or web data extraction to compile and store information from websites on the Internet. But why do you need to use web scraping

Bilginin güç olduğunu hepiniz bilirsiniz. En iyi bilgi parçalarına erişmek için bazı veri toplama görevlerini yerine getirmeniz gerekir. En iyi yöntemlerden biri, internetteki web sitelerinden bilgi derlemek ve depolamak için web kazıma veya web veri çıkarımıdır. Ancak aynı görevi verileri kopyalayıp yapıştırarak da gerçekleştirebiliyorsanız neden web kazıma yöntemini kullanmanız gerekiyor?

Sorunun cevabı, metni kopyalamanın ve görüntüleri kaydetmenin kolay olduğudur. Ancak bir web sitesinden hacimli miktarda veri çıkarırken bu yaklaşım pratikte imkansızdır. Verileri toplamak için kopyala ve yapıştır tekniğini kullanırsanız günler ve hatta aylar sürebilir. Bu nedenle, web sitelerinden büyük miktarda veriyi otomatik bir şekilde çıkarmak için kullanılan web kazıma işlemine ihtiyaç duyulmaktadır. Binlerce web sitesi sayfasından veri toplamak yalnızca dakikalar veya saatler alacaktır. Ayrıca, bilgileri rahatça analiz etmek için verileri indirebilir ve dışa aktarabilirsiniz.

Zaman, bir insanın hayatındaki en değerli varlıktır. Web kazıma yöntemini kullanarak zamandan tasarruf edebilir ve verileri daha yüksek bir hacimde kazıyabilirsiniz. Aşağıda, hayatınızı otomatikleştirebilecek bazı web kazıma kullanım örnekleri verilmiştir.

Web kazıma işlemini aşağıdaki gibi günlük görevleri gerçekleştirmek için kullanabilirsiniz:

Web kazıma bu görevleri nasıl yerine getirebilir? Bir iş arama örneğini ele alalım. İşsiz olduğunuzu ve iş analisti olarak iş aradığınızı varsayalım. Her gün uyanıyor, Indeed'i (en önde gelen iş sitesi) kontrol ediyor ve yeni işler için birden fazla sayfayı kaydırıyorsunuz. Çok sayıda sayfa arasında iş arama süreci 20-30 dakika sürebilir.

Bu süreci otomatikleştirerek zamandan ve emekten tasarruf edebilirsiniz. Örneğin, uyandığınız her gün size bir e-posta gönderebilecek ve Indeed'deki iş analisti iş ilanının tüm ayrıntılarını sıralanmış bir tabloda içeren bir web kazıma programı oluşturabilirsiniz. Bu şekilde, günlük iş ilanlarını görmek sadece birkaç dakikanızı alacaktır.

İnternetten veri kopyalayıp yapıştırmak yerine, web kazıma yöntemini kullanarak verileri doğru bir şekilde toplayabilir ve etkili bir şekilde yönetebilirsiniz. Verileri web'den kopyalamak ve bilgisayarda bir yere yapıştırmak sıkıcı ve zaman alıcı manuel bir süreçtir. Otomatik web veri çıkarma işlemini kullanabilir ve bunu .csv dosyası, elektronik tablo vb. gibi yapılandırılmış bir formatta kaydedebilirsiniz. Bu şekilde, normal bir insanın elde etmeyi umabileceğinden daha yüksek hacimde veri toplayabilirsiniz. Daha gelişmiş web kazıma işlemleri için verilerinizi bir bulut veritabanında saklayabilir ve günlük olarak çalıştırabilirsiniz.

Bir şirketin markası önemli bir değere sahiptir. Her marka olumlu bir çevrimiçi algıya sahip olmak ister ve müşterilerin rakipleri yerine kendi ürünlerini satın almasını ister.

Markalar web kazıma işlemini şunun için kullanıyor:

Sosyal medya platformlarında ürünleriyle ilgili yorumlarını kontrol ederek müşterilerinin mevcut sesini anlayabilirler. Bu şekilde müşterilerin ürünlerini beğenip beğenmediklerini tespit edebilirler. Böylece web kazıma, olumsuz yorumları hızlı bir şekilde tespit etmelerini ve marka bilinirliğine verilen zararı azaltmalarını sağlar.

Bir işletme işletiyorsanız, mevcut fiyatlarınızı rakiplerin fiyatlarıyla karşılaştırarak optimize edebilirsiniz. Rekabetçi bir fiyatlandırma planı oluşturmak için bunu web kazıma yoluyla otomatik olarak yapabilirsiniz. Burada şu soru ortaya çıkıyor: Web kazıma bir fiyatlandırma planı oluşturmaya nasıl yardımcı olur? Sorunun cevabı, web kazıma yoluyla milyonlarca ürünün fiyatlandırma verilerini toplayabileceğinizdir. Dalgalanan piyasa taleplerini karşılamak için ürün fiyatlarının dinamik olarak değiştirilmesi gerekecektir. Bu şekilde, web kazıma ile otomatik veri toplama, işletmelerin bir fiyatlandırma planı oluşturmasına yardımcı olur.

Web kazıma, rakiplerinize kıyasla işletmeniz için en yetenekli adayları işe almanıza olanak tanır. İlk olarak, mevcut piyasa becerisini anlamak için web kazıma yöntemini kullanırsınız ve ardından iş ihtiyaçlarınıza uygun geliştiricileri işe alabilirsiniz.

Arama Motoru Optimizasyonu (SEO) web sitesi trafiğini artırmayı ve ziyaretçileri potansiyel müşterilere dönüştürmeyi amaçlar. Çok sayıda veri toplamak, optimize ettikleri anahtar kelimeler ve yayınladıkları içerik hakkında fikir edinmek için web kazıma yöntemini kullanabilirsiniz. Verileri topladıktan sonra, nişinize en uygun stratejileri geliştirmek için analiz edebilir ve değerli çıkarımlar yapabilirsiniz.

Proxy'ler web'den veri kazımak için nasıl önemlidir? Aşağıda, güvenli web veri çıkarımı için proxy kullanmanın bazı nedenleri verilmiştir.

Kullandığınız proxy havuzu, aşağıda belirtilen çeşitli faktörlere bağlı olan belirli bir boyuta sahiptir.

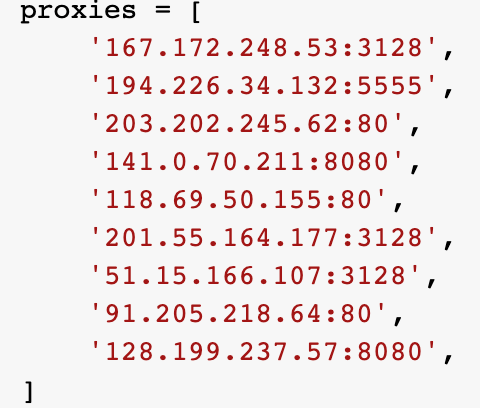

Bazı web siteleri kullanmak için ücretsiz bir proxy listesi sunar. Ücretsiz proxy listesini almak için aşağıdaki kodu kullanabilirsiniz.

İlk olarak, bazı gerekli içe aktarmaları yapmalısınız. Python'un isteklerini ve BeautifulSoup modülünü içe aktarmalısınız.

i̇thalat talepleri̇

import random

from bs4 import BeautifulSoup as bsWeb sitesinin URL'sini içeren bir fonksiyon tanımlamanız gerekir. Bir çorba nesnesi oluşturabilir ve HTTP yanıtını alabilirsiniz.

def get_free_proxies():

url = "https://free-proxy-list.net/"

soup = bs(requests.get(url).content, "html.parser")

proxies = []Ardından, aşağıdaki kodda gösterildiği gibi ücretsiz proxy'lerin tablosunu alabilen bir for döngüsü kullanmanız gerekir.

for row in soup.find("table", attrs={"id": "proxylisttable"}).find_all("tr")[1:]:

tds = row.find_all("td")

try:

ip = tds[0].text.strip()

port = tds[1].text.strip()

host = f"{ip}:{port}"

proxies.append(host)

except IndexError:

continue

return proxiesAşağıdaki çıktı, çalışan bazı proxy'leri göstermektedir.

We at ProxyScrape offer a

Otomatik web kazıma veya web veri çıkarma yöntemini kullanarak zamandan tasarruf edebilir ve bir web sitesinden daha yüksek hacimlerde veri toplayabilirsiniz. Bir ürünü sipariş etmek, e-posta göndermek, web sitelerinde iş aramak gibi tüm süreçleri otomatikleştirmenize ve alışveriş zamanınızdan tasarruf etmenize olanak tanır. Manuel veri çıkarma işlemleri sıkıcı ve zaman alıcıdır. Bu nedenle, zamandan tasarruf etmenizi ve çabanızı azaltmanızı sağlayacak web kazıma araçları gibi otomatik veri toplama araçlarını kullanmalısınız. Rakiplerinizin ürün fiyatlarını kontrol etmek, markanızı izlemek ve görevlerinizi otomatikleştirmek için web kazıma özelliğini kullanabilirsiniz. Hedef web sitesine yasaklanmadan çok sayıda istekte bulunmak için bir proxy havuzu kullanabilirsiniz. Proxy havuzunun boyutu, yaptığınız isteklerin sayısına ve veri merkezi veya konut IP'leri gibi IP'lerin kalitesine bağlıdır.